基于深度学习的训练模型优化方法与应用研究分析

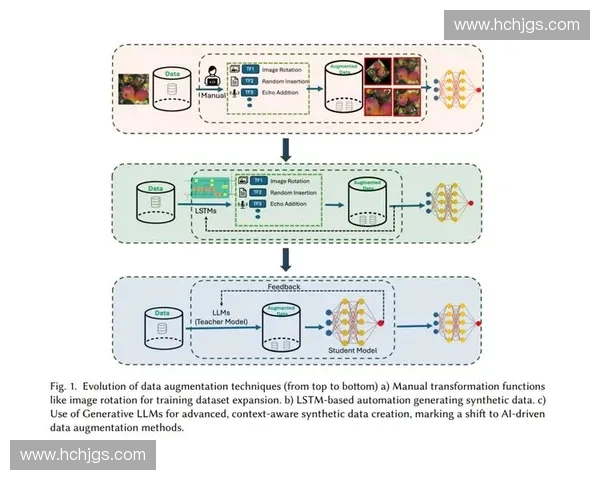

随着深度学习技术的飞速发展,基于深度学习的训练模型优化成为了当前人工智能研究的热点。深度学习模型的优化不仅影响模型的训练效率,还直接决定了其在实际应用中的性能表现。本文将从四个方面详细探讨基于深度学习的训练模型优化方法与应用研究分析。首先,介绍深度学习模型优化的基础理论及其重要性;接着,讨论常见的优化算法及其应用场景;然后,探讨如何在实际问题中应用这些优化方法,尤其是在不同领域的实际案例中;最后,结合当前研究趋势,分析深度学习模型优化的未来发展方向。通过这些内容的阐述,本文将为深度学习模型优化方法的理解与应用提供深入的分析和思考。

1、深度学习模型优化的基础理论

深度学习模型的优化过程是指通过调整模型的参数,使其在特定任务上达到最优性能。优化的核心目标是最小化损失函数,这通常通过反向传播算法(Backpropagation)来实现。反向传播通过计算梯度并更新网络参数,逐步提高模型的预测准确性。为了使优化过程更加高效,常常需要结合合适的学习率调整策略以及正则化手段。

在优化深度学习模型时,梯度下降是最常用的优化方法。它通过计算损失函数的梯度,并沿着梯度的反方向更新模型参数,从而逐步逼近损失函数的最小值。虽然梯度下降法简单易懂,但它也存在局部最小值和鞍点问题,这对优化过程带来挑战。为此,研究人员提出了多种改进版本,如随机梯度下降(SGD)和Adam优化器。

除了基本的优化算法外,深度学习模型的优化还需要考虑多个因素,例如网络的层数、每层的神经元数目、激活函数的选择等。这些因素不仅影响模型的训练效果,也决定了其最终的泛化能力。因此,如何合理设计网络结构以及优化训练过程中的超参数,成为提升深度学习模型性能的关键。

2、常见的深度学习优化算法

深度学习中最基础的优化算法是梯度下降法,它有多种变种,包括批量梯度下降、随机梯度下降和小批量梯度下降。批量梯度下降在每次更新时使用整个数据集的平均梯度,计算量大但收敛稳定。而随机梯度下降(SGD)则是在每次更新时使用单个数据点,计算量小但可能导致收敛不稳定。小批量梯度下降通过在每次更新时使用一小批数据,结合了两者的优点,常被用在实际应用中。

Adam优化器是当前应用最广泛的深度学习优化算法之一。与传统的梯度下降方法不同,Adam结合了动量和自适应学习率的方法。它在每次更新时,不仅考虑梯度的大小,还考虑梯度的历史信息,使得参数更新更加平滑。由于其较高的计算效率和稳定性,Adam成为了许多深度学习任务中的首选优化器。

除了梯度下降类方法,近年来,研究人员还提出了基于进化算法和群体智能的优化方法。例如,遗传算法和粒子群优化算法通过模拟自然界的进化过程,搜索损失函数的最优解。这些方法虽然计算复杂度较高,但在某些问题中能有效避免局部最优,找到全局最优解。

3、深度学习模型优化的应用场景

深度学习模型的优化方法在众多领域中都有广泛应用。在计算机视觉中,深度学习优化算法用于提高图像分类、目标检测和图像生成等任务的性能。例如,卷积神经网络(CNN)通过优化网络结构和训练策略,能够在图像识别任务中达到超过人类的精度水平。

在自然语言处理领域,深度学习模型的优化同样发挥着重要作用。以语言模型为例,经过优化的深度学习模型能够生成流畅的自然语言文本,在机器翻译、文本摘要和情感分析等任务中展现出强大的能力。Transformer模型的优化则是当前研究的热点,通过并行计算和自注意力机制,有效提升了训练效率和模型性能。

此外,深度学习的优化方法也被广泛应用于语音识别、推荐系统和自动驾驶等领域。在语音识别中,深度神经网络(DNN)通过优化声学模型,提高了语音到文本的转换准确率。推荐系统则通过优化协同过滤和深度学习模型,精确预测用户的兴趣爱好,从而提高推荐的准确性和个性化水平。

4、深度学习模型优化的未来发展

尽管目前深度学习模型在许多领域取得了显著的成果,但在模型优化的过程中仍然面临诸多挑战。首先,深度学习模型的训练通常需要大量的计算资源,这对硬件设备和能耗提出了较高的要求。因此,未来的优化方法将更加关注模型的高效性,如何通过硬件加速和算法改进降低计算成本将是研究的一个重点方向。

此外,深度学习模型的可解释性问题仍然是一个重要的研究方向。尽管深度学习模型能够实现高精度的预测,但其“黑箱”特性使得很多应用场景中的决策过程无法被清晰理解。未来的优化方法不仅要提高模型性能,还应考虑如何增强模型的可解释性,使其更好地应用于医疗、金融等领域。

最后,随着人工智能技术的不断发展,深度学习模型的优化方法将更加多元化,涵盖更多的领域和应用场景。从自动机器学习(AutoML)到自适应算法的研究,未来的优化方法将越来越智能化,为解决更加复杂的问题提供新的思路。

星空官网总结:

基于深度学习的训练模型优化方法在各个领域中都有广泛的应用。随着优化算法的不断发展,深度学习模型的训练效率和性能得到了显著提升。优化算法的改进不仅提高了模型的准确性,还使得模型能够适应更多复杂的任务。

然而,当前的优化方法仍面临一些挑战,如计算资源消耗大、模型可解释性差等问题。未来的研究将致力于开发更加高效和可解释的优化方法,以应对日益复杂的应用需求。通过不断优化,深度学习技术将在更多领域中发挥重要作用,推动人工智能的进一步发展。